Бесплатный фрагмент - О Информации, системах счисления и алгебре Буля

С примерами и задачами

I. Информация

1.1. Представление информации

Информация (от лат. informatio — разъяснение, изложение, осведомленность) — одно из наиболее общих понятий науки, обозначающее некоторые сведения, совокупность каких-либо данных, знаний и т. п. В связи с широким распространением этого понятия трудно дать его однозначное определение. Существует много определений информации, отображающих разные точки зрения на нее.

ИНФОРМАЦИЯ:

— Является важнейшим стратегическим ресурсом современной информационной системы.

— Один из основоположников теории информации Клод Шеннон определил информацию как уменьшение степени неопределенности знания о каком-либо объекте, системе, процессе или явлении или как снятую неопределенность.

Формы представления информации

Информационное сообщение может существовать, передаваться и восприниматься в самых разнообразных видах и формах:

— В виде знаков: это цифры и арифметические знаки, используемые в математике, условные графические изображения.

— В виде символов, которые могут быть представлены буквами алфавита, специальными обозначениями, используемыми для создания текстов и рисунков.

— В форме звуковых, световых сигналов и радиоволн, применяемых в радиовещании, телефонии, телевизионной трансляции.

— В форме устной речи.

— В форме магнитных полей.

— В форме электрического тока или напряжения, на которых основана работа двигателей, генераторов и других технических устройств.

— В форме био- или энерго-информационных полей и т. д.

— Для обработки и преобразования информации любого вида существуют специальные устройства.

— Информация, как материя и энергия, обладает определённым объёмом, который может быть измерен.

— В электронно-вычислительных машинах, устройствах и средствах техники связи используется объёмный способ измерения информации, учитывающий количество символов, содержащихся в сообщении. Длина сообщения при этом обусловлена используемым алфавитом

1.2. Количество и единицы измерения информации

Измерение количества информации

— Количество информации, заключенное в сообщении, определяется объемом знаний, который это сообщение несет получающему его человеку.

При обработке информации с помощью технических средств удобно пользоваться количественным определением любой величины, как меры уменьшения неопределённости, а для этого необходимо выбрать единицу измерения.

— Единица измерения количества информации называется битом. Сообщение, уменьшающее неопределенность знания человека в два раза, несет для него 1 бит информации.

— Количество информации, заключенное в сообщении — х битов и

— число N равновероятных событий их появления связаны формулой:

— 2Х=N

— Пример 1. При бросании монеты сообщение о результате жребия несет 1 бит информации, поскольку количество возможных вариантов результата равно 2. Оба эти варианта равновероятны. Решение: Решаем уравнение: 2Х=2, откуда х=1 бит.

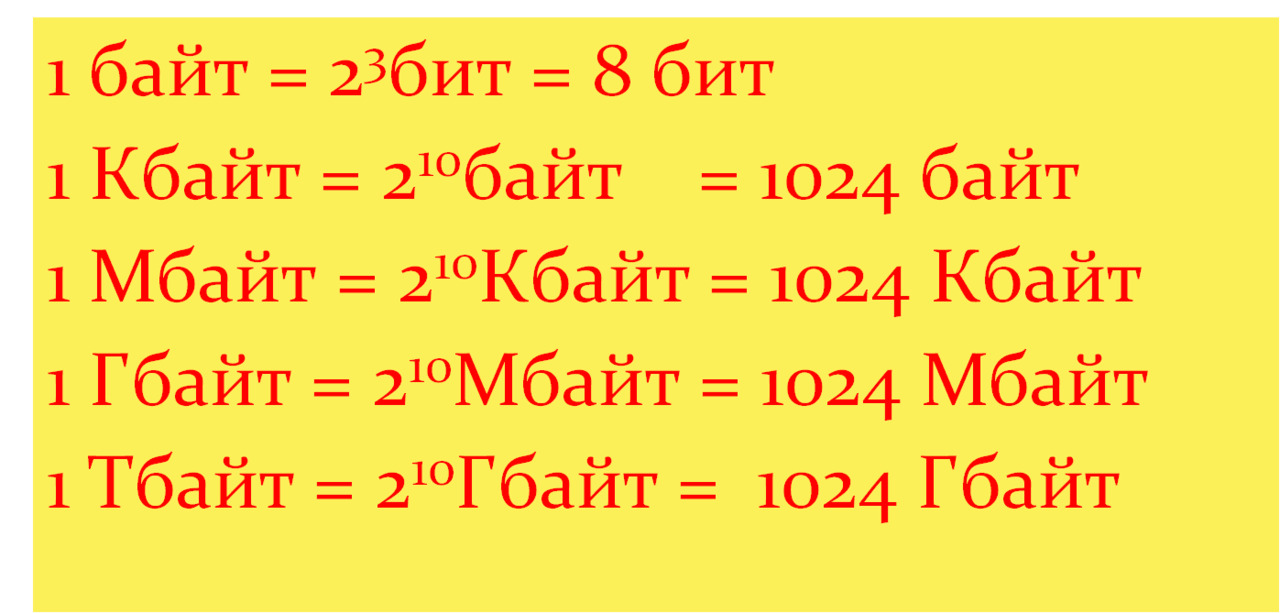

Единицы информации

Представление текстовой информации.

Двоичное кодирование текстовой информации используется для кодирования каждого символа 1 байт (8 двоичных разрядов), что позволяет закодировать 256 различных символов (буквы русского и латинского алфавита, цифры, знаки и графические символы), т.е. для представления текстовой информации используется алфавит мощностью 256 символов. Но 8 бит = 1 байту, а 1 бит = 1 разряду двоичного числа и может принимать значения равные нулю или единице.

Количество текстовой информации:

N = 2Х = 28 = 256, где N — количество символов с пробелами, X — количество информации в битах.

Представление графической информации.

— Двоичное кодирование графической информации представляет собой достаточно сложный процесс, поэтому такая информация может быть представлена от простых чертежей до видеофильмов. Графические изображения из аналоговой формы в цифровую преобразуются путем пространственной дискретизации. Изображение разбивается на отдельные маленькие фрагменты (точки или пиксели), причем каждый элемент может иметь свой цвет.

— При изображении точки состояния «чёрная» или «белая» необходим 1 бит. Цветные изображения могут иметь различную глубину цвета, определяемую числом Бит на точку: 4, 8, 16, 24.

— Видеопамять — оперативная память, хранящая видеоинформацию во время ее воспроизведения в изображение на экране.

— Пиксель — наименьший элемент изображения на экране, т.е. минимальный участок изображения, которому можно задать цвет.

— Растр — прямоугольная сетка пикселей на экране.

— Глубина цвета — количество информации, которое используется при кодировании цвета точек изображения.

— Разрешающая способность растрового изображения определяется количеством точек по горизонтали и вертикали на единицу длины изображения.

— Размер изображения определяется числом точек по горизонтали и по вертикали монитора, т.е. разрешающих способностей экрана: 640 х 480; 800 х 600; 1024 х 768;

— 1280 х 1024 точки.

— Графический режим вывода изображения на экран определяется разрешающей способностью экрана и глубиной цвета.

— Полная информация обо всех точках изображения, хранящаяся в видеопамяти, называется битовой картиной изображения.

— Количество цветов, воспроизводимых на экране дисплея (К), и число битов, отводимых в видеопамяти под каждый пиксель (N), определяется формулой: К=2N

— Разрешающая способность экрана — размер сетки растра, задаётся произведением M ∙ N, где М — число точек по горизонтали, а N — число точек по вертикали.

— Страница — раздел видеопамяти, вмещающей информацию об одном образе экрана (одной «картинке» на экране). В видеопамяти могут размещаться одновременно несколько страниц.

— Необходимый объём видеопамяти для хранения информации о всех точках изображения рассчитывается по формуле: Объём видеопамяти = Разрешающая способность растрового изображения, умноженная на Глубину цвета.

— Например, для графического режима 800 х 600 точек и глубине цвета 16 бит на точку требуемый объём видеопамяти будет равен

— 800 х 600 х 16 бит = 7 680 000 бит = 960 000 байт = 937,5 Кбайт.

Представление звуковой информации.

— Физическая природа звука — колебания в определенном диапазоне частот, передаваемые звуковой волной через воздух. Для того, чтобы компьютер мог обрабатывать реальный звук, непрерывный звуковой сигнал должен быть преобразован в цифровую дискретную форму с помощью временной дискретизации. Непрерывная звуковая волна разбивается на отдельные маленькие временные участки, причем для каждого такого участка устанавливается определенная величина интенсивности звука.

— Двоичное кодирование звуковой информации представляет собой двоичное кодирование непрерывного звукового сигнала после его дискредитации, т.е. преобразования в последовательность электрических импульсов — выборок.

— Точность процедуры двоичного кодирования определяется числом дискретных значений, которое может обеспечить звуковая карта компьютера, и числом дискретных выборок, выполненных за одну секунду.

— Частота дискретизации звука — это количество измерений входного сигнала за 1 секунду. Частота измеряется в герцах (Гц.,1000 измерений за 1 секунду — 1 килогерц). Частота дискредитации звука может лежать в диапазоне от 8 000 до 48 000 измерений громкости звука за одну секунду.

— Глубина кодирования звука — это количество информации, которое необходимо для кодирования дискретных уровней громкости цифрового звука.

— Количество уровней громкости:

N=2I,

где I — глубина кодирования, а N — количество уровней громкости.

— Размер цифрового аудиофайла:

— (в байтах) = (частота дискредитации в Гц) * (время записи в секундах) * (разрешение в битах) / 8 бит.

2.Подходы к понятию и измерению информации. Информационные объекты различных видов

2.1.Подходы к понятию и измерению информации

— Существует два подхода к измерению информации:

1) алфавитный (количество информации в тексте определяется независимо от его содержания, воспринимая текст как последовательность символов);

2) содержательный или вероятностный (количество информации в тексте связывается с содержанием текста, учитывая вероятности его символов).

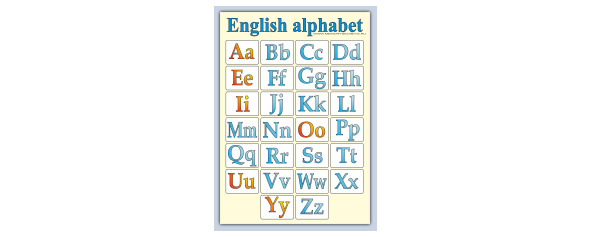

— Алфавит — это множество символов, используемых при записи текста.

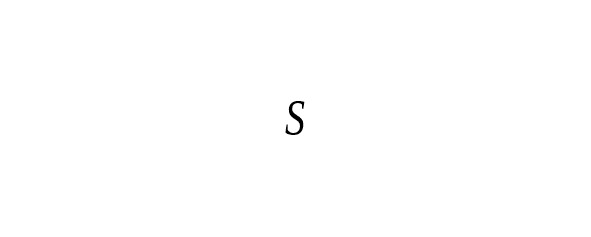

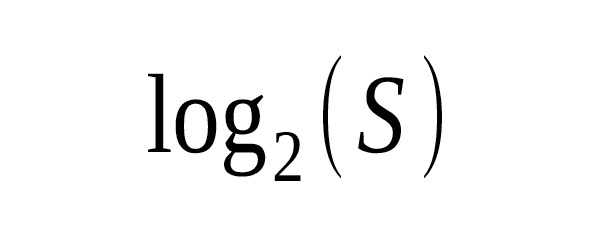

— Мощность алфавита S — это количество символов

алфавита.

— Информационный вес одного символа i — это

количество информации в одном символе.

— Информационный вес символа двоичного алфавита принят за единицу измерения информации и называется 1 бит.

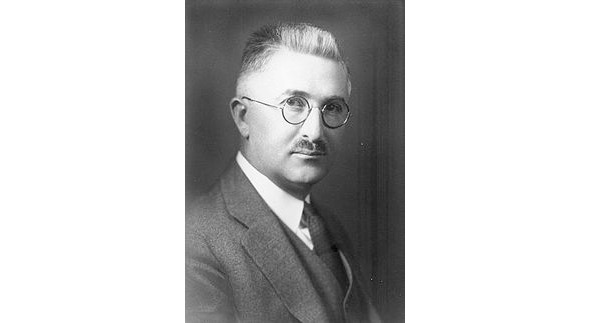

Впервые информацию измерил американский инженер Ральф Хартли в 1928 году.

Р. Хартли предполагал, что:

— появление символов в сообщении длины l равновероятно, т.е., ни один из символов не имеет преимущества перед другими

символами,

— мощность алфавита равна S.

— Каждый символ сообщения содержит

информации.

— Следовательно, сообщение длины l должно содержать в l раз больше информации, т.е., информации.

Бесплатный фрагмент закончился.

Купите книгу, чтобы продолжить чтение.